Resumo da notícia:

- O NVIDIA Dynamo 1.0 oferece uma base de código aberto pronta para produção para inferência em escala.

- As otimizações do Dynamo e do NVIDIA TensorRT-LLM integram-se nativamente a frameworks de código aberto, como LangChain, llm-d, LMCache, SGLang e vLLM, para impulsionar o desempenho de inferência.

- O Dynamo aumenta o desempenho de inferência das GPUs NVIDIA Blackwell em até 7 vezes, reduzindo o custo por token e aumentando as oportunidades de receita para milhões de GPUs com software gratuito e de código aberto.

- A plataforma de inferência da NVIDIA foi integrada por provedores de serviços em nuvem, como Amazon Web Services (AWS), Microsoft Azure, Google Cloud e Oracle Cloud Infrastructure (OCI), juntamente com os parceiros de nuvem da NVIDIA: Alibaba Cloud, CoreWeave, Together AI e Nebius — e adotada por empresas nativas de IA, como Cursor e Perplexity; provedores de endpoints de inferência Baseten, Deep Infra e Fireworks; e empresas globais ByteDance, Meituan, PayPal e Pinterest.

A NVIDIA anuncia o NVIDIA Dynamo 1.0, um software de código aberto para inferência generativa e agentiva em grande escala, com ampla adoção global. Juntamente com a plataforma NVIDIA Blackwell, o Dynamo 1.0 permite que provedores de nuvem, inovadores em IA e empresas globais ofereçam inferência de IA de alto desempenho com escala, eficiência e velocidade incomparáveis.

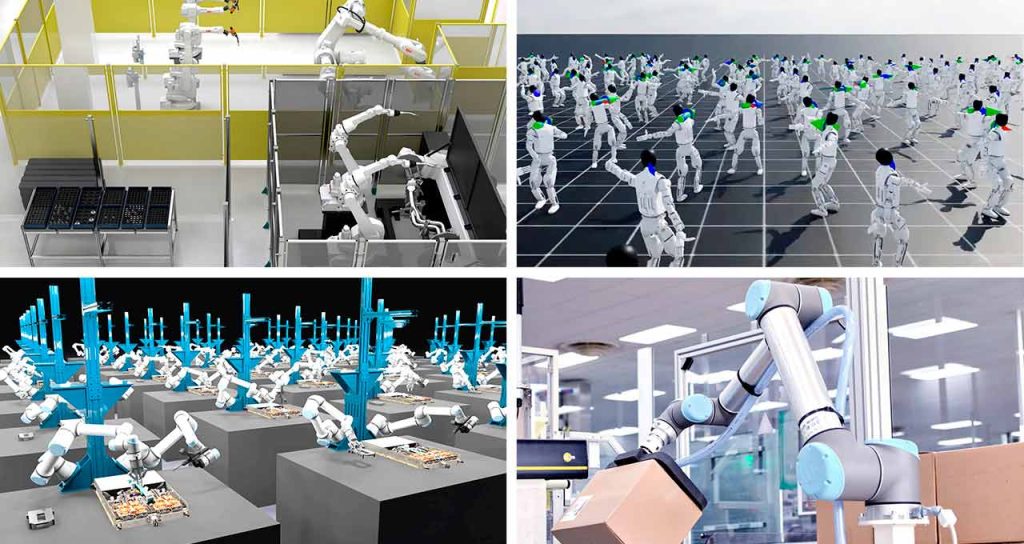

À medida que os sistemas de agentes de IA entram em produção em diversos setores, escalar a inferência dentro de um data center tornou-se um desafio complexo de orquestração de recursos, com solicitações de tamanhos e modalidades variados, bem como objetivos de desempenho, chegando em picos imprevisíveis.

Assim como o sistema operacional de um computador coordena o hardware e os aplicativos, o Dynamo 1.0 funciona como o “sistema operacional” distribuído das fábricas de IA, orquestrando de forma integrada os recursos de GPU e memória em todo o cluster para dar suporte a cargas de trabalho complexas de IA. Em testes de desempenho recentes do setor, o Dynamo aumentou o desempenho de inferência das GPUs NVIDIA Blackwell em até 7 vezes, reduzindo o custo por token e aumentando as oportunidades de receita para milhões de GPUs com software gratuito e de código aberto.

“A inferência é o motor da inteligência, impulsionando cada consulta, cada agente e cada aplicação”, afirma Jensen Huang, fundador e CEO da NVIDIA. “Com o NVIDIA Dynamo, criamos o primeiro ‘sistema operacional’ de todos os tempos para fábricas de IA. A rápida adoção em todo o nosso ecossistema mostra que esta nova onda de IA agentiva já está aqui, e a NVIDIA está impulsionando-a em escala global.”

O Dynamo 1.0 distribui o trabalho de inferência entre as GPUs, incorporando um “controle de tráfego” mais inteligente e a capacidade de transferir dados entre as GPUs e armazenamentos de menor custo, reduzindo o desperdício de recursos e aliviando as restrições de memória. No caso de IA autônoma e prompts longos, ele pode direcionar as solicitações para as GPUs que já possuem a “memória de curto prazo” mais relevante das etapas anteriores e, em seguida, descarregar essa memória quando ela não for mais necessária.

“O que antes parecia distante começa a se materializar com mais velocidade à medida que surgem novas formas de criar, organizar e utilizar dados em escala. Esse avanço abre caminho para acelerar o desenvolvimento de aplicações em áreas como robótica, visão computacional e sistemas autônomos, aproximando cada vez mais a IA das operações reais das empresas e da sociedade”, complementa Marcio Aguiar, diretor da divisão Enterprise da NVIDIA para América Latina.

A plataforma de inferência da NVIDIA ganha força

A NVIDIA está impulsionando o ecossistema de código aberto ao integrar o Dynamo e as otimizações da biblioteca NVIDIA TensorRT™-LLM em frameworks populares de fornecedores como LangChain, llm-d, LMCache, SGLang, vLLM e outros. Componentes essenciais do Dynamo, como o KVBM para gerenciamento mais inteligente da memória, o NVIDIA NIXL para transferência rápida de dados entre GPUs e o NVIDIA Grove para escalonamento simplificado, também estão disponíveis como módulos independentes. A NVIDIA também contribui com kernels CUDA® do TensorRT-LLM para o projeto FlashInfer, para que possam ser integrados nativamente em frameworks de código aberto.

A plataforma de inferência da NVIDIA é compatível com todo o ecossistema de IA, incluindo:

- Provedores de serviços em nuvem: Amazon Web Services (AWS), Microsoft Azure, Google Cloud, OCI

- Parceiros de nuvem da NVIDIA: Alibaba Cloud, CoreWeave, Crusoe, DigitalOcean, Gcore, GMI Cloud, Lightning AI, Nebius, Nscale, Together AI, Vultr

- Empresas nativas de IA: Cursor, Hebbia, Perplexity

- Provedores de pontos de extremidade de inferência: Baseten, Deep Infra, Fireworks

- Empresas globais: AstraZeneca, BlackRock, ByteDance, Coupang, Instacart, Meituan, PayPal, Pinterest, Shopee, SoftBank Corp.

Chen Goldberg, vice-presidente executivo de produtos e engenharia da CoreWeave, afirma: “À medida que a IA passa de projetos-piloto experimentais para uma produção contínua em grande escala, a infraestrutura subjacente deve ser tão dinâmica quanto os modelos que ela suporta. O suporte ao NVIDIA Dynamo nos permite oferecer um ambiente mais integrado e resiliente para a implantação de agentes de IA complexos. Essa base proporciona a durabilidade e a orquestração de alto desempenho necessárias para levar as cargas de trabalho de agentes mais ambiciosas do setor à produção global.”

Danila Shtan, diretor de tecnologia da Nebius, explica: “Oferecer inferência de IA confiável em grande escala não se resume apenas a GPUs potentes, mas também ao software que transforma esse desempenho em resultados reais para os clientes. Valorizamos o modo como a pilha de software da NVIDIA, do Dynamo ao TensorRT-LLM, proporciona otimização profunda, desempenho previsível e um tempo de implantação mais rápido, ajudando-nos a oferecer aos clientes um caminho mais simples e de maior desempenho para a IA em produção.”

Matt Madrigal, diretor de tecnologia do Pinterest, complementa: “Oferecer uma experiência de IA intuitiva e multimodal a centenas de milhões de usuários requer inteligência em tempo real em escala global. Como importantes adeptos do código aberto, estamos comprometidos com o desenvolvimento de tecnologias de IA escaláveis. Com o NVIDIA Dynamo otimizando nossa implantação, estamos ampliando as experiências personalizadas e sem interrupções que oferecemos, impulsionadas por uma infraestrutura de IA de alto desempenho.”

O Dynamo 1.0 já está disponível para desenvolvedores em todo o mundo. Para saber mais e começar a usar, leia o blog e visite a página do Dynamo.

Sobre a NVIDIA

Desde sua fundação em 1993, a NVIDIA (NASDAQ: NVDA) tem sido pioneira em computação acelerada. A invenção da GPU pela empresa em 1999 estimulou o crescimento do mercado de games para PC, redefiniu a computação gráfica, iniciou a era da IA moderna e tem ajudado a digitalização industrial em todos os mercados. A NVIDIA agora é uma empresa de infraestrutura de computação full-stack com soluções em escala de data center que estão revolucionando o setor. Mais informações em: https://www.nvidia.com/pt-br/.